21世纪经济报道记者倪雨晴 圣何塞报道

当地时间3月18日上午,英伟达GTC2025大会高潮来袭,英伟达创始人兼CEO黄仁勋一身酷黑皮衣登场演讲。今年,推理、token成为整场的高频关键词,可以明显地感觉到,英伟达对“Next AI”的叙事,已经转向推理阶段。

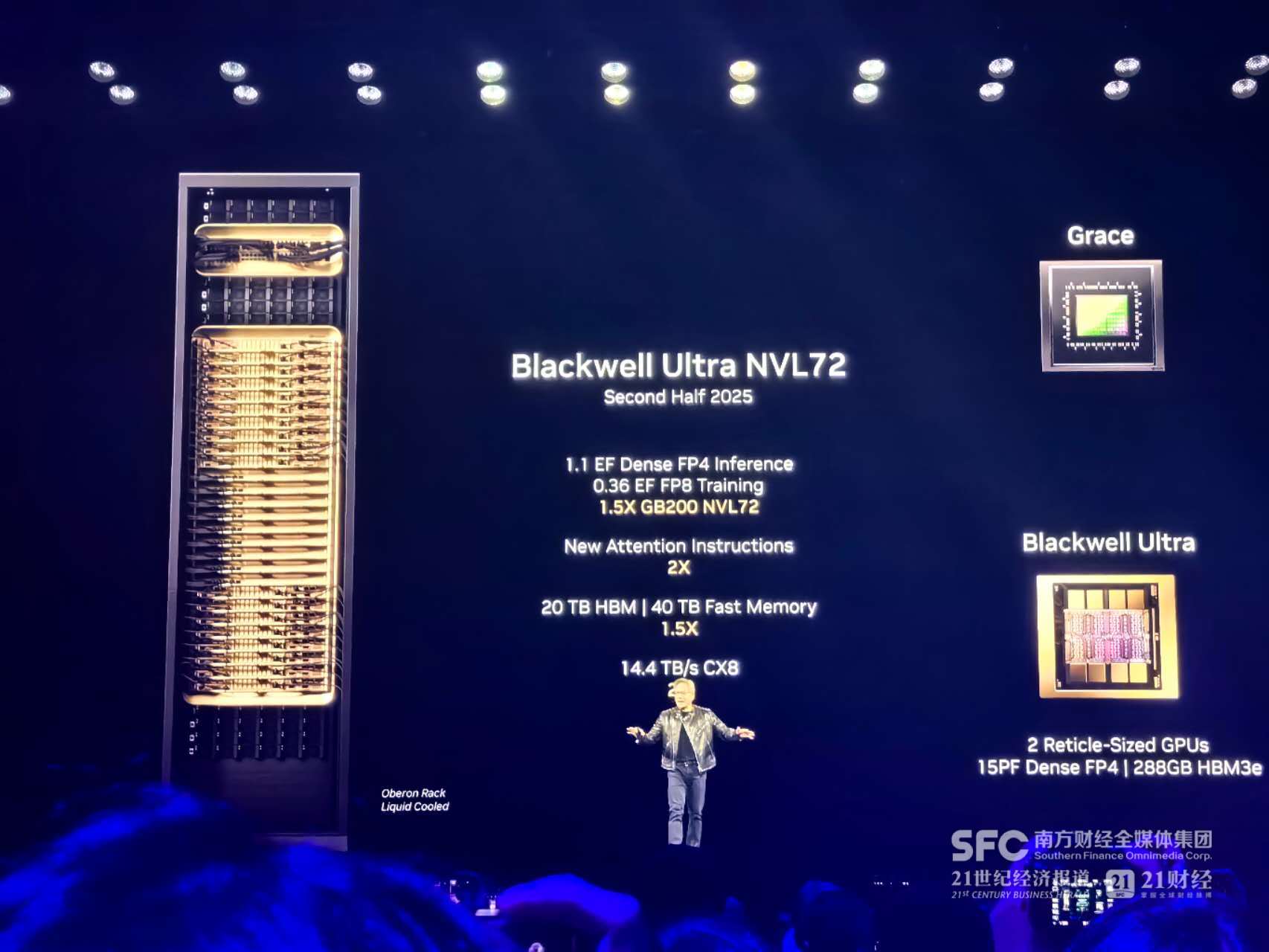

在外界关注的芯片平台上,黄仁勋宣布了Blackwell Ultra GPU和下一代架构Vera Rubin。

新的平台尤其强化了推理能力,英伟达称Blackwell Ultra在训练和测试时间缩放推理(Test-Time Scaling Inference)方面实现了突破,并且将Blackwell Ultra称为AI工厂平台,将开启AI推理新时代。

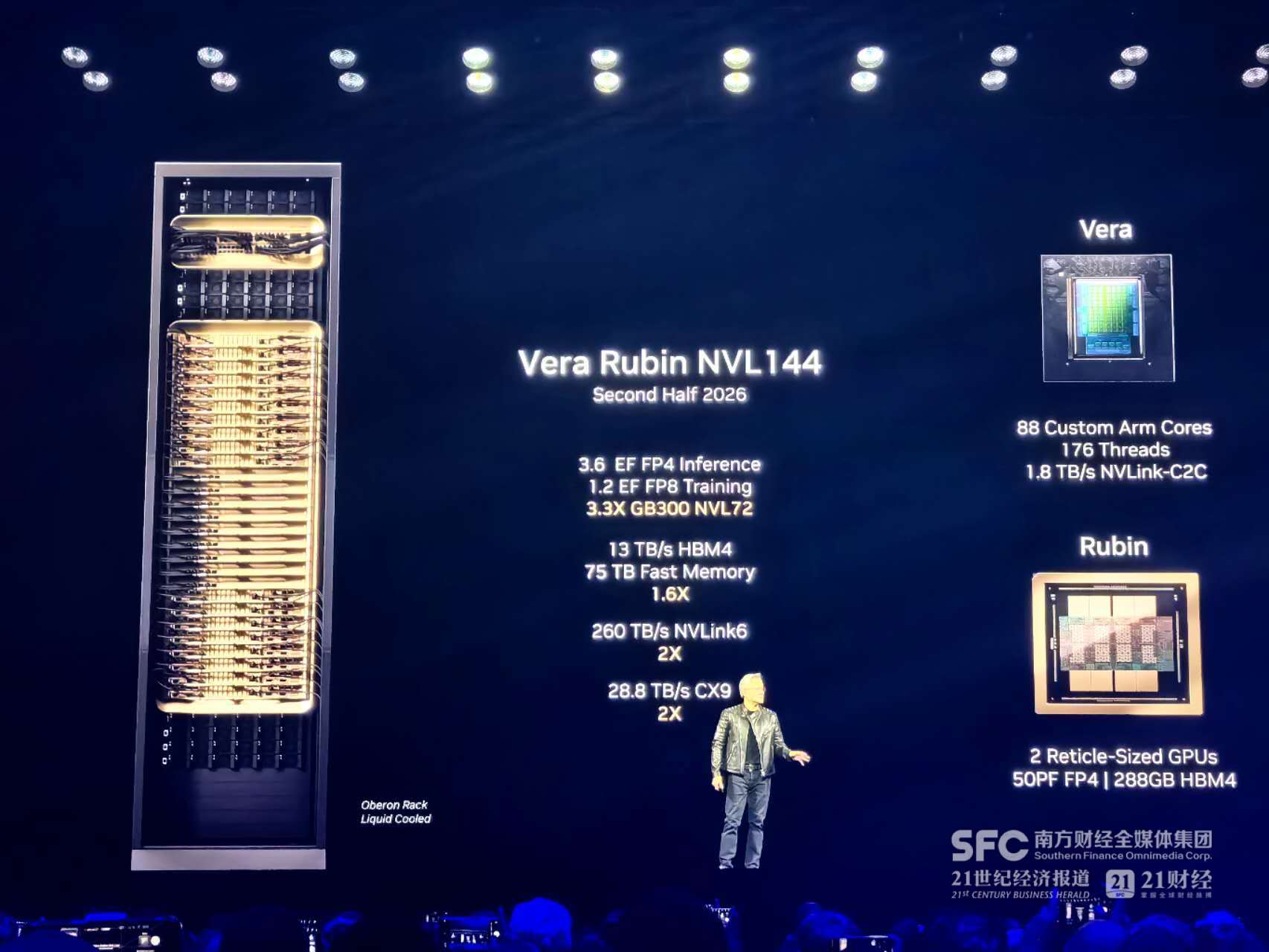

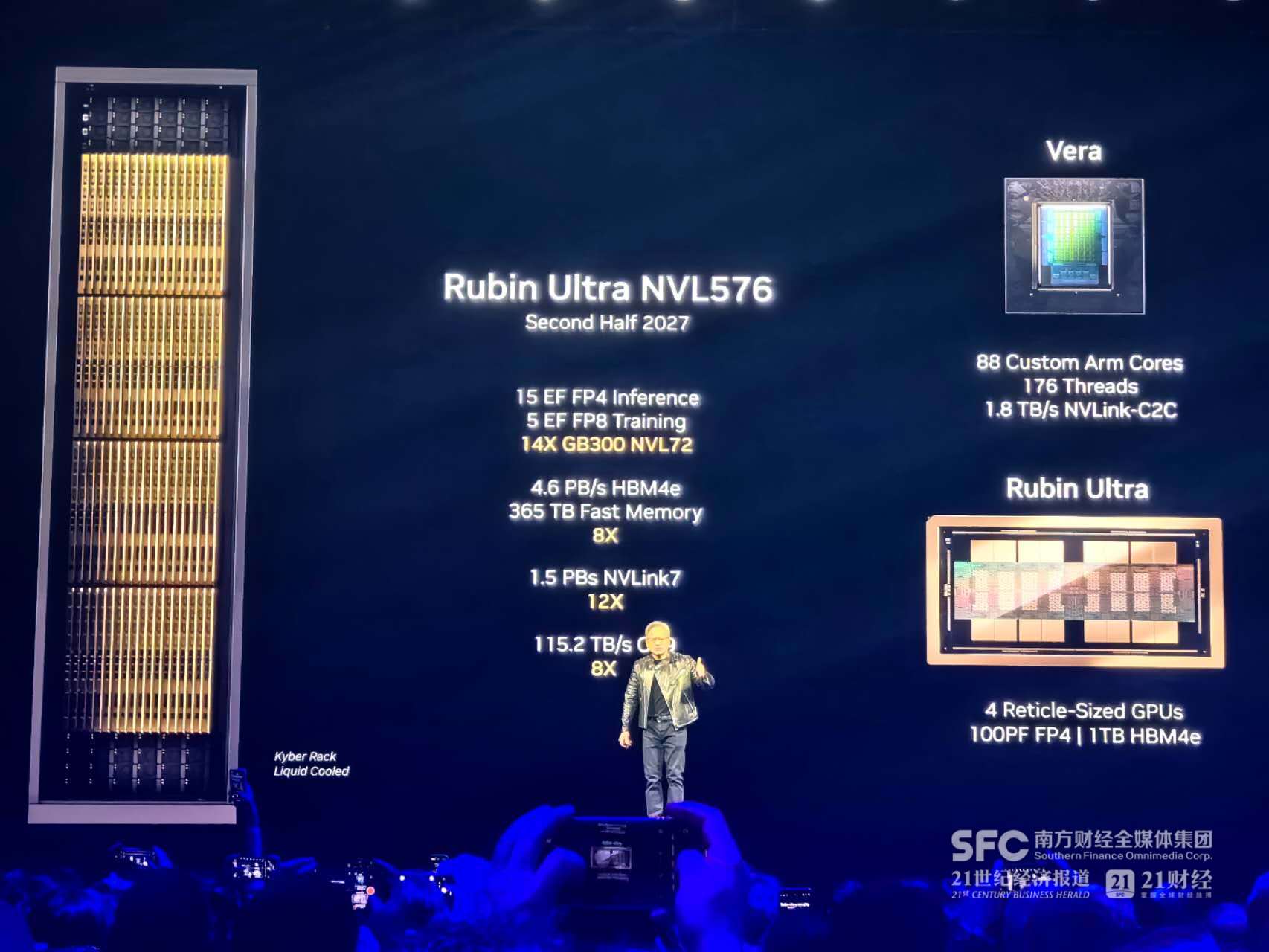

下一代平台Vera Rubin NLV144计划在2026年下半年上线,Rubin Ultra NVL576将在2027年下半年推出。去年黄仁勋称,英伟达将进入一年一次的升级节奏,以往为两年迭代一次。

具体来看,Blackwell Ultra(GB300)包含GB300 NVL72机架级解决方案和HGX B300 NVL16 系统。其中,GB300 NVL72是将72颗Blackwell Ultra GPU与36颗基于Arm Neoverse架构的Grace CPU互联,形成一个超大规模的AI计算单元。

GB300 NVL72相较GB200 NVL72的AI性能提升1.5倍,并使AI工厂的收益机会相比Hopper平台提高50倍。英伟达表示,GB300 NVL72预计将集成至DGX Cloud,DGX SuperPOD(企业级AI基础设施)也将采用 GB300 NVL72机架架构,提供开箱即用的AI工厂解决方案。

再看HGX B300 NVL16,英伟达给出的数据显示,相较Hopper代际产品,在大语言模型推理方面,推理速度提高11倍、计算能力提升7倍、内存容量扩大4倍。这些突破使其能够高效运行最复杂的AI任务,特别适用于AI推理计算、深度推理及超大规模推理工作负载。

整体而言,这款面向AI推理时代的旗舰级GPU平台,不仅是英伟达Blackwell架构的又一力作,也标志着AI计算焦点,从大模型预训练向深度推理与复杂推理的转变,将为数据中心、企业AI工厂及自动驾驶、机器人等领域提供强劲的计算能力。

“AI已经迈出了巨大的飞跃,推理AI和代理AI对计算性能的需求呈指数级增长,”黄仁勋表示,“我们正是为这个关键时刻设计了Blackwell Ultra——这是一款全能AI平台,能够高效执行预训练、后训练和推理等任务。”

去年,Blackwell架构刚刚发布,GB200系列在上个季度为英伟达带来110亿美元的营收。接下来,最新的 Blackwell Ultra能够接棒GB200再创新高?

瑞银(UBS)在3月17日的报告中指出,Blackwell系列的需求依然非常强劲,GB200机架的残存的瓶颈现已完全解决,英伟达正加快B300/GB300(Blackwell Ultra)的推出时间,预计将在第一季度提前量产,并在2025年第三季度实现大规模出货。

英伟达表示,基于 Blackwell Ultra的产品预计将于2025年下半年开始由合作伙伴陆续推出。思科、戴尔、惠普、联想和超微将率先推出基于Blackwell Ultra 的服务器。 浪潮旗下Aivres、华擎机架、华硕、富士康、技嘉、英业达、和硕、广达、纬创和纬颖等硬件制造商也将提供Blackwell Ultra服务器解决方案。

此外,英伟达还发布了一款AI推理服务软件——推理框架NVIDIA Dynamo ,为了最大化AI工厂在推理AI模型中的token收益。据介绍,它通过协调并加速数千颗GPU之间的推理通信,采用分离式推理架构(Disaggregated Serving),使大语言模型的输入处理(Processing Phase)和推理生成(Generation Phase)分别在不同 GPU 上运行。这样可以让每个阶段根据自身需求进行独立优化,确保 GPU 资源的最大化利用,从而实现更高效的 AI 推理计算。

不论是硬件平台还是软件产品,今年整场发布会的指向很明确,一切向推理推进。发布会一半以上的时间,黄仁勋都在谈论推理带来的巨大市场,强调三个scaling定律继续发展。黄仁勋说,在AI scaling 放缓方面,几乎“全世界都搞错了”。在他看来,由于新scaling技术,AI的进化速度比以往任何时候都快。